Большинство компаний сегодня уже не задаются вопросом «нужен ли нам ИИ».

Вопрос другой: что делать с данными, которые уже есть?

Логи, изображения, видео — всё это потенциально можно использовать для моделей. Но почти сразу возникает следующая развилка:

- собирать команду разметчиков внутри

- или отдавать задачу на аутсорсинг

И на этом этапе многие принимают решение слишком быстро.

Почему «сделаем сами» кажется логичным

Первое желание — держать процесс внутри:

-

данные не покидают контур

-

проще контролировать качество

-

команда всегда «под рукой»

Но через несколько месяцев появляется реальность:

-

объем задач скачет — то перегруз, то простой

-

людей нужно нанимать, обучать, удерживать

-

качество сильно зависит от конкретных исполнителей

-

менеджмент начинает тратить время на операционку

В итоге разметка превращается не в инструмент развития ИИ, а в дополнительную нагрузку.

Почему «отдать на аутсорсинг» тоже не панацея

Вторая крайность — полностью вынести разметку на внешних исполнителей.

На бумаге это выглядит интересно:

— не нужно держать штат

— можно быстро масштабироваться

Но на практике часто происходит следующее:

-

подрядчик работает «в отрыве» от вашей команды

-

задачи передаются кусками, без контекста

-

требования к качеству постоянно уточняются

-

результат требует доработки

В итоге появляется новая проблема: данные есть, подрядчик есть, а процесса нет.

Где «узкое место» разметки данных?

Ключевой вопрос не в том, где делать разметку — внутри или снаружи.

Проблема в другом: есть ли у вас управляемый процесс работы с данными

Если нет, то не работает ни одна модель:

-

внутренняя команда перегружается

-

внешний подрядчик дает нестабильный результат

-

сроки становятся непредсказуемыми

-

стоимость разметки «размывается»

И самое важное — скорость разработки ИИ падает.

Какой выход есть у компаний?

Зрелый подход — перестать воспринимать разметку как разовую задачу.

И начать рассматривать её как сервис внутри ML-процесса.

Это означает:

-

есть единая логика работы с задачами

-

понятна загрузка и приоритеты

-

качество контролируется системно

-

можно гибко подключать внешние ресурсы

То есть вопрос «внутри или аутсорс» перестает быть ключевым.

Появляется гибридная модель.

Что это меняет на практике

Вместо выбора «или/или» появляется управляемая схема:

-

базовая экспертиза остается внутри

-

операционный объем масштабируется через внешние команды

-

задачи не теряются и не дублируются

-

качество становится предсказуемым

И главное: разметка перестает быть узким местом

Почему это критично для бизнеса

Когда компания начинает внедрять ИИ не в виде пилота, а в работе, она быстро сталкивается с реалиями: основное время уходит не на модели, а на подготовку данных.

Сначала всё выглядит управляемо. Есть одна команда, один кейс, понятный объем данных. Разметку делают либо внутри, либо через подрядчика — и это работает.

Но дальше появляются новые задачи. Параллельно запускаются другие инициативы: где-то нужно классифицировать изображения, где-то — размечать видео, где-то — готовить датасеты под новые модели. И в какой-то момент выясняется, что разметка — это уже не одна задача, а постоянный поток.

И вот здесь начинает вырисовываться проблема.

Одна команда ждет данные для обучения, другая уже загрузила подрядчика своими задачами, третья только формулирует требования. Никто не видит общей картины. Нет понимания, сколько задач в работе, какие из них приоритетные и когда будет результат.

В итоге модели простаивают не потому, что их сложно разработать, а потому что нет готовых данных. Проверка гипотез растягивается, релизы откладываются, а команда начинает работать в режиме постоянного догоняющего.

Именно в этот момент становится понятно: разметка — это не вспомогательная функция, а узкое место всей системы.

Кейс: как разметка данных тормозила e-commerce и как это исправили

Дано

Крупный e-commerce проект с постоянным потоком новых товаров. Задача — ускорить вывод карточек на витрину через автоматизацию.

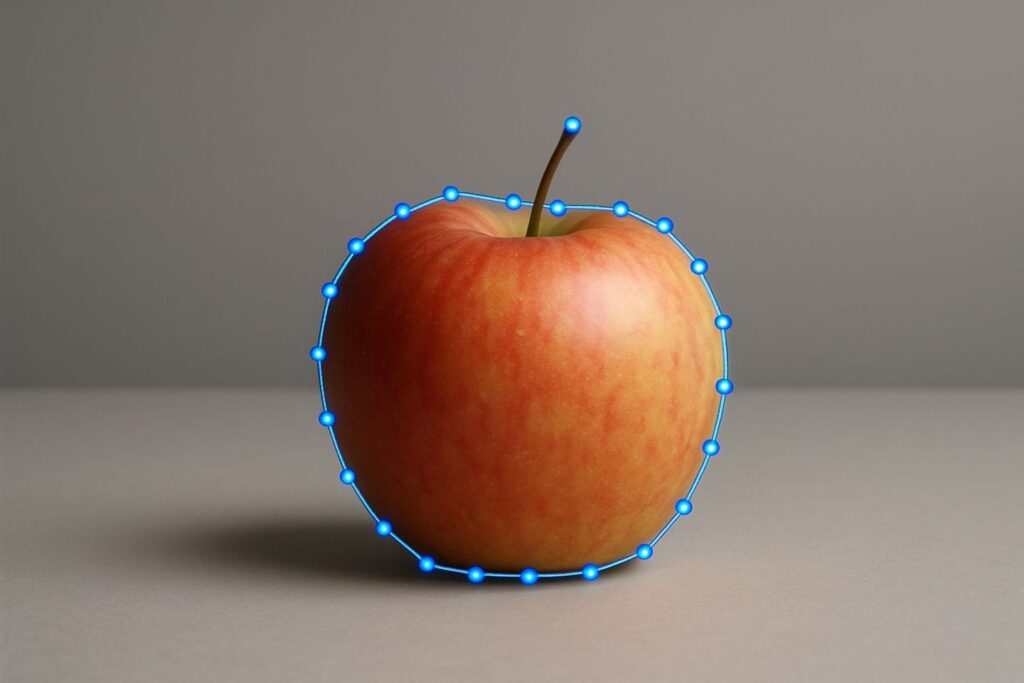

Для этого требовалась разметка:

-

изображений товаров

-

категорий

-

атрибутов (цвет, тип, характеристики)

В работе участвовали:

— внутренняя команда

— внешний подрядчик

Объем — десятки тысяч объектов в неделю с ростом.

Проблема

Формально все было: люди, подрядчик, задачи. Но процесс не работал как система.

На практике:

-

задачи передавались через Excel и чаты

-

требования менялись по ходу работы

-

не было единого статуса по задачам

-

часть данных размечалась повторно

-

подрядчик то простаивал, то не успевал

Ключевая проблема: не было прозрачности и управляемости

Нельзя было ответить на базовые вопросы:

— сколько задач сейчас в работе

— какой срок выполнения

— какая фактическая стоимость разметки

Дополнительно:

-

до 30–40% задач возвращались на переразметку

-

сроки отличались в разы

-

команда тратила время на контроль, а не на развитие продукта

В результате разметка стала узким местом: товары задерживались, а команда работала в режиме «ручного управления».

Решение

Не стали увеличивать команду или менять подрядчика. Пересобрали сам процесс.

Что изменили:

— ввели единую точку входа для всех задач (все запросы проходят через один контур, а не через чаты)

— зафиксировали требования до запуска (инструкции, критерии качества, формат результата)

— разделили процесс на этапы:

постановка → оценка → запуск → контроль → приемка

— внедрили контроль качества внутри процесса, а не после (часть задач валидируется автоматически, часть — через QA)

— сделали прозрачный статус задач (видно, что в работе, что в очереди, что завершено)

— синхронизировали загрузку подрядчика (нет ситуаций «ждет задачи» или «захлебнулся объемом»)

Важно: подрядчик остался тем же, но стал частью системы, а не отдельным блоком. Полный разбор архитектуры и логики процесса — на нашем сайте.

Результат

После внедрения:

-

объем обработки — сотни тысяч объектов в месяц

-

доля переразметки снижена кратно

-

задачи перестали накапливаться в очередях

-

сроки стали прогнозируемыми

Бизнес-эффект:

-

ускорился вывод товаров на витрину

-

снизилась нагрузка на внутреннюю команду

-

исчезла необходимость постоянного ручного контроля

Ключевой результат: разметка перестала быть узким местом и начала масштабироваться вместе с бизнесом

Когда это уже проблема, а не «рабочий процесс»

Понять, что разметка начала ломать процесс, довольно просто — это всегда видно по цифрам и операционке.

Например:

Вы ставите задачу на разметку и не можете заранее сказать, когда получите результат. Один и тот же тип задачи сегодня делается за 2 дня, завтра — за неделю.

Или:

часть данных возвращается на переразметку. Не 2–3%, а 20–30%. Это значит, что модель обучается на нестабильных данных, а команда тратит время на повторную работу.

Еще один явный сигнал — отсутствие прозрачности. В любой момент времени невозможно ответить:

— сколько задач сейчас в работе

— какой объем в очереди

— какая фактическая загрузка команды

— сколько стоит разметка одного типа данных

Вместо этого появляется «ручное управление»: менеджеры пишут подрядчику, уточняют статусы, дергают исполнителей, синхронизируются в чатах. Фактически появляется отдельный слой работы — управление разметкой.

И самый дорогой симптом: модели ждут данные.

Data science команда готова двигаться дальше, но не может — потому что датасет не готов.

Что это означает на самом деле

Это не вопрос подрядчика. И не вопрос «нужно больше людей».

Это означает, что:

- разметка уже стала потоком

- но процесс остался ручным

И в этот момент не важно:

- делаете вы разметку внутри

- или отдаете на аутсорсинг

Без системы оба варианта дают один и тот же результат: непредсказуемые сроки, плавающее качество и рост затрат.

Вывод

Разметка данных — это первый этап, на котором бизнес либо ускоряет внедрение ИИ, либо начинает его тормозить.

Проблема не в подрядчиках и не в людях. Проблема в том, что компании пытаются управлять потоком данных как разовыми задачами.

Пока объем небольшой — это работает. Как только появляется масштаб — процесс разваливается: сроки плавают, качество нестабильно, команда уходит в операционку.

И в этот момент выбор «делать внутри или отдать на аутсорсинг» перестает иметь значение. Без системы оба варианта дают одинаковый результат.

Рабочая модель появляется только тогда, когда разметка становится управляемым процессом: с понятной логикой, прозрачной загрузкой и контролем качества.

Именно это и позволяет:

— ускорять разработку моделей, а не ждать данные

— масштабировать ИИ-инициативы без роста команды

— превращать данные из «сырья» в рабочий актив

Если этого нет — ИИ в компании всегда будет упираться не в технологии, а в подготовку данных.

Подробно, как это реализуется на практике, можно посмотреть на нашем сайте.